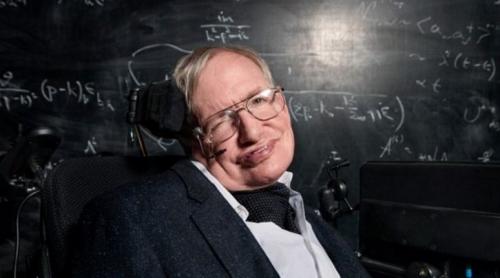

"De la începuturile civilizației, agresivitatea a fost utilă umanității, în măsura în care a contribuit la supraviețuire. De-a lungul evoluției, agresivitatea a fost adânc întipărită în genele noastre. În acest moment, ritmul de progres în domeniul tehnologic este atât de rapid, încât tocmai această agresivitate ne-a putea conduce la distrugere, printr-un război nuclear sau biologic. Din acest motiv acest instinct trebuie să fie controlat de logică și rațiune", și-a exprimat părerea regretatul fizicianul Stephen Hawking.

Hawking sugera că o anumită formă de guvernare la nivel planetarar putea diminua acest pericol, dar că și această soluție ar putea crea la rândul său probleme.

"S-ar putea ca această formă de guvernare să devină până la urmă o tiranie. Tot scenariul meu s-ar putea să vă pară apocaliptic, dar eu sunt optimist și cred că omul va reuși să facă față cu succes acestor provocări.

Hawking a avut maui multe intervenție pesimistă în ceea ce privește viitorul omenirii.

În 2015, într-o sesiune de răspunsuri la întrebările utilizatorilor Reddit, Hawking remarca faptul că Inteligența Artificială ar putea atinge un nivel de la care ar fi capabilă să ne extermine, în mod total neintenționat.

"Riscul produs de Inteligența Artificială nu este cel produs de intenția cu adevărat criminală, ci de competență. O Inteligență Artificială de nivel înalt va fi extrem de performantă în a îndeplini sarcinile, dar dacă aceste ținte nu vor fi corelate cu ale noastre, atunci vom fi cu adevărat în pericol", spunea Hawking.

"Crearea inteligenţei artificiale va fi cel mai mare eveniment din istoria umanităţii, Dar ar putea fi şi ultimul. O astfel de formă de inteligenţă ar putea să se emancipeze şi chiar să-şi îmbunătăţească propria concepţie, la o viteză merez în creştere. Oamenii, limitaţi de evoluţia lor biologică lentă, nu vor putea rivaliza, şi vor fi detronaţi", mai spunea el.